- 廣告 -

微軟(Microsoft)近年傾盡全力將旗下 AI 助理 Copilot 推銷給全球企業及個人用戶,並以「提升生產力」為主要賣點。然而,近日有媒體發現微軟在使用條款中「自打嘴巴」,明文指出 Copilot 只是「供娛樂用途」,呼籲用戶切勿依賴它來獲取重要建議,引發社交網絡熱議。微軟隨後急忙解畫,澄清該條款屬「遺留用語(Legacy Language)」,承諾將於下次更新中修改相關字眼。

免責條款惹議 坦承 AI 會犯錯

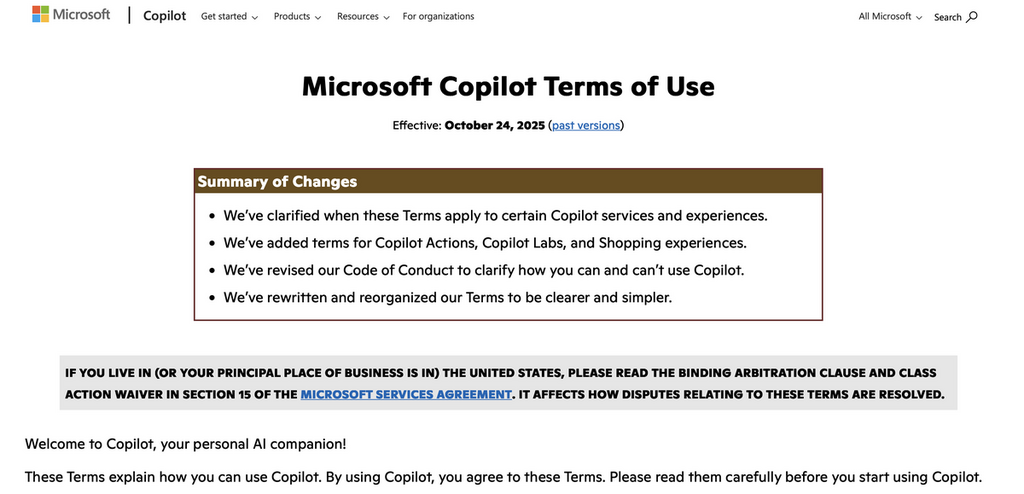

根據 TechCrunch 及 Tom’s Hardware 報道,惹起爭議的《Microsoft Copilot 個人使用條款》最後更新日期為 2025 年 10 月 24 日。 當中明確警告用戶:「Copilot 僅供娛樂用途。它可能會犯錯,且可能無法按預期運作。請勿依賴 Copilot 獲取重要建議。使用 Copilot 需自行承擔風險。」 這段免責聲明與微軟致力說服企業客戶付費訂閱 Copilot 的積極態度形成強烈對比,讓不少用戶質疑微軟對自家 AI 產品的信心。

官方承諾修改 業界普遍設「免死金牌」

面對外界的質疑,微軟發言人向媒體解釋,隨著產品不斷演進,該段舊有條款已無法反映 Copilot 現今的實際使用情況,並承諾會在下一次條款更新時作出修改。不過,報道亦指出,設立這類極端的免責條款在生成式 AI 領域其實相當普遍。 除了微軟,例如 OpenAI 及 Elon Musk 旗下的 xAI 等巨頭,均在其服務條款中警告用戶不應將 AI 的輸出視為「唯一事實」或「真理」。 此舉主要是為了防範用戶產生過度依賴機器的「自動化偏見」,並為 AI 產生「幻覺」或提供錯誤資訊時提供法律上的「免死金牌」。

- 廣告 -